Искусственный интеллект (ИИ) семимильными шагами входит во все сферы нашей жизни, и здравоохранение — не исключение.

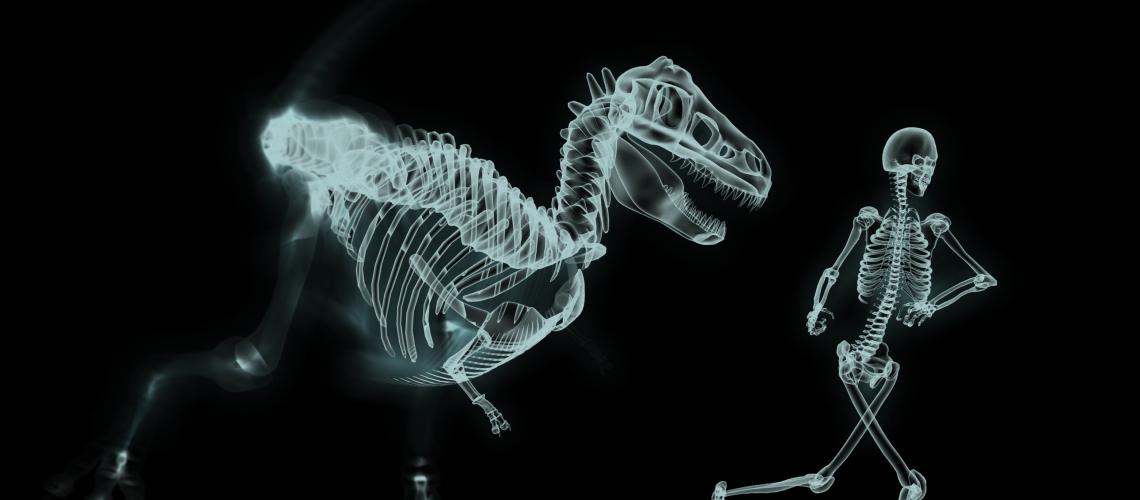

Сгенерированные ИИ-изображения уже используются во многих странах в качестве обучающих материалов для студентов, для наполнения баз данных по редким патологиям и для машинного обучения.

Для того, чтобы «натренировать» ИИ распознавать патологии, требуются тысячи изображений, однако собрать такое количество клинических случаев зачастую просто невозможно. В таком случае, высокоточные сгенерированные изображения, или по-другому «дипфейки», позволяют заполнить брешь в нехватке реальных снимков и избежать бюрократической волокиты, связанной с их получением и публикацией.

Несмотря на практическую пользу дипфейков, врачи все больше переживают из-за проблем, связанных с безопасностью и достоверностью данных, поскольку грань между реальным изображением и «подделкой» стирается.

Чтобы понять, насколько хорошо специалисты и существующие мультимодальные большие языковые модели (MLLM) могут отличать сгенерированные рентгенограммы от подлинных клинических изображений, недавно провели исследование, в котором участвовали 17 рентгенологов с опытом работы от 0 до 40 лет.

Оценка проводилась в три этапа:

1. Оценка 154 снимков вслепую, без разглашения цели исследования. Одна половина снимков была подлинной, а вторая — сгенерирована ChatGPT (GPT-4o).

2. Оценка проводилась повторно, но уже после раскрытия цели; ту же задачу поручили нескольким MLLM.

3. Оценка 110 рентгенограмм грудной клетки (половина сгенерирована программой RoentGen*, вторая половина — подлинные) рентгенологами и моделями MLLM.

Лишь 7 рентгенологов на первом этапе заподозрили наличие дипфейков среди снимков.

На втором этапе врачи обнаруживали сгенерированные изображения в среднем с точностью 74,8%, различные MLLM справлялись с задачей в 59,1–85,1% случаев.

На третьем этапе точность распознавания «поддельных» рентгеновских снимков грудной клетки рентгенологами и MLLM оказалась схожа: врачи делали правильный выбор примерно в 70% ситуаций, тогда как показатель ИИ-моделей варьировался от 51,8% до 89,1%.

Таким образом, ни одна MLLM, даже ChatGPT-4o, использованная для создания дипфейк-снимков, не смогла обнаружить все сгенерированные изображения. Но и рентгенологам, в сою очередь, не удалось определить все 100% дипфейков.

Эти результаты говорят о том, что необходимо лучше обучать и врачей, и программы ИИ распознавать «подделки».

Злоупотребление дипфейками может приводить к их использованию в мошеннических целях, судебных разбирательствах или к манипулированию информацией. И тот факт, что каждый пятый сгенерированный ИИ рентгеновский снимок избежал обнаружения экспертами, подчеркивает эту уязвимость.

*RoentGen — органоспецифическая диффузионная модель, обученная для генерации рентгенограмм грудной клетки.

MLLM (англ. Multimodal large language model) — мультимодальная большая языковая модель; ИИ — искусственный интеллект.

https://pubs.rsna.org/doi/10.1148/radiol.252094#fig2